时间序列分析

基本概念与实战

时间序列轻量级自适应网络

-

+

首页

时间序列轻量级自适应网络

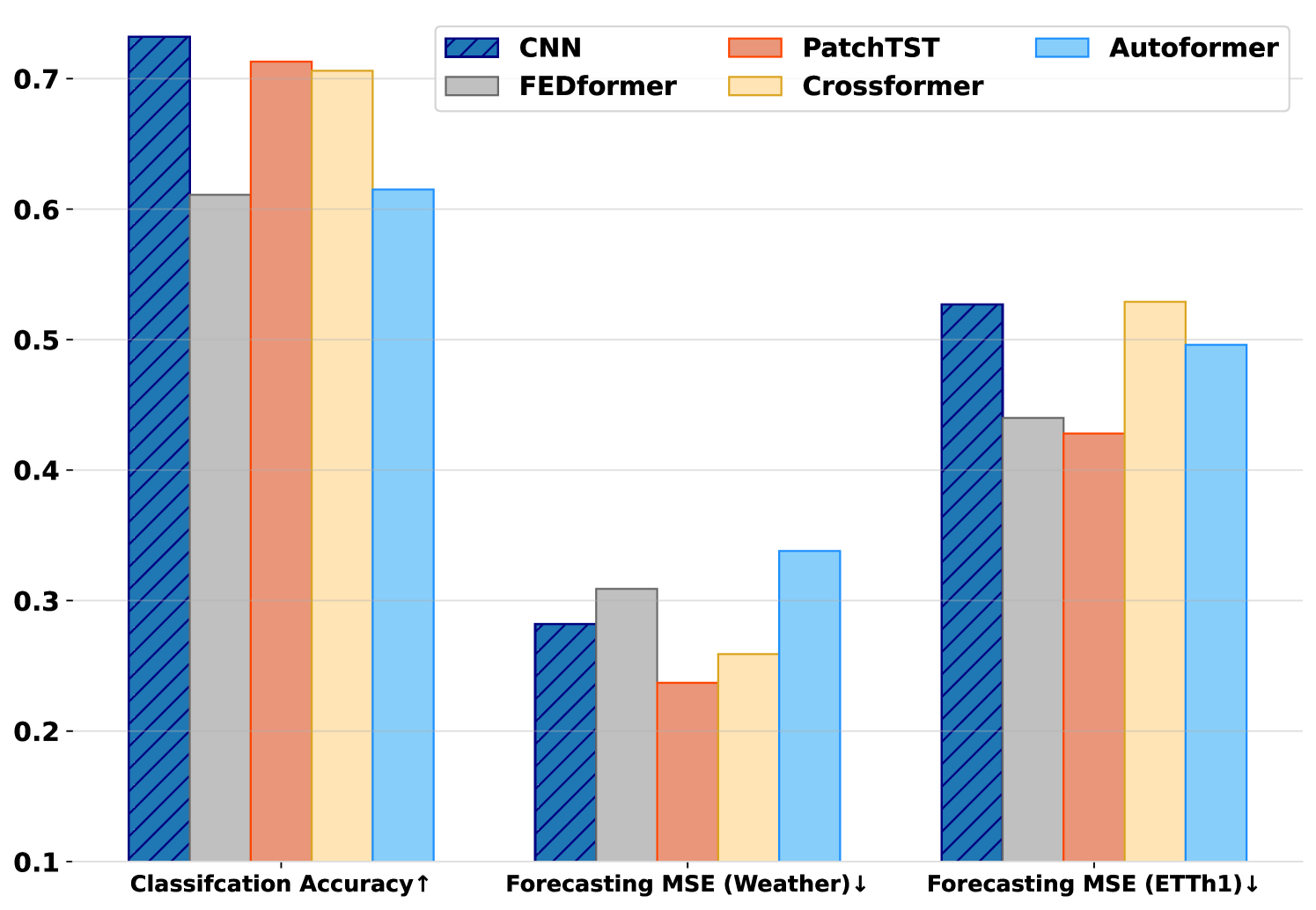

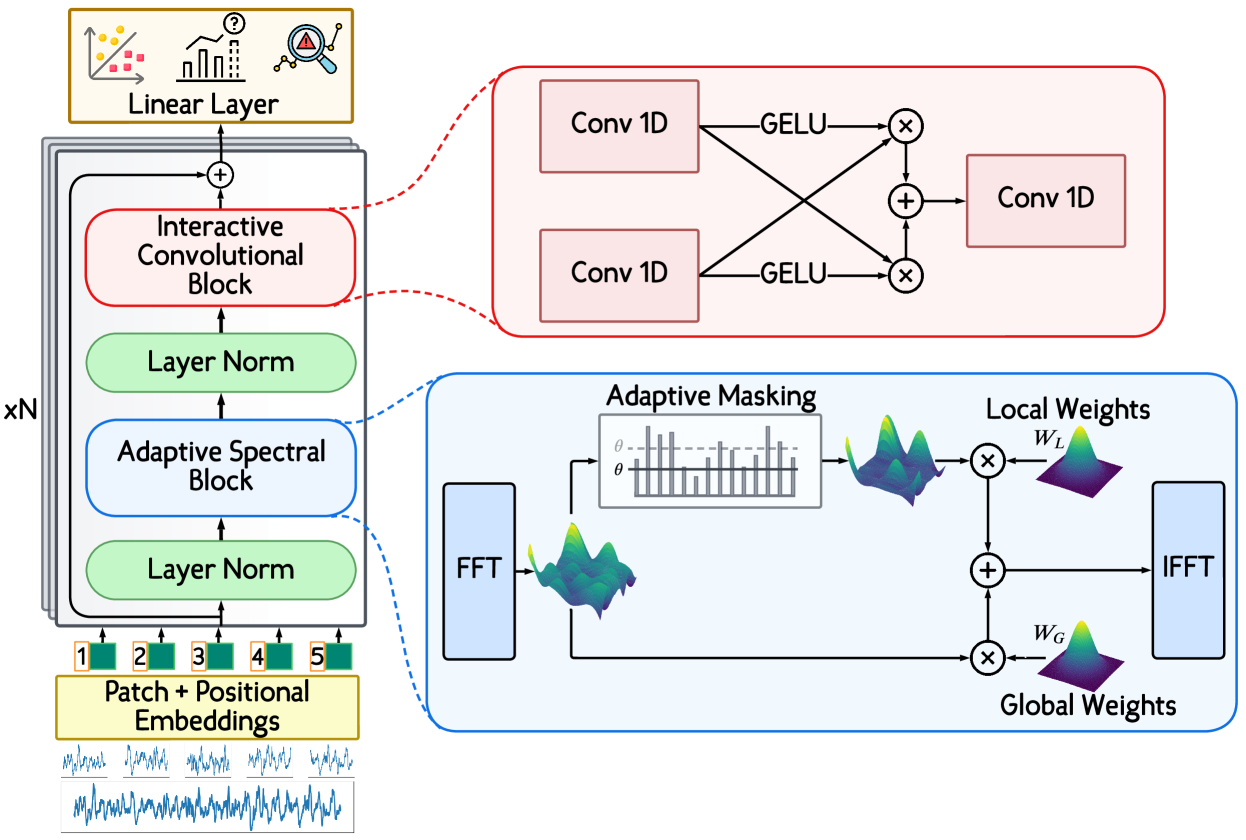

# TSLANet: Rethinking Transformers for Time Series Representation Learning 时间序列轻量级自适应网络 TSLANet是一种新颖的时间序列轻量级自适应网络,旨在解决Transformer模型在时间序列数据处理中的局限性。该模型利用自适应谱块和交互式卷积块来增强特征表示,捕获长短期交互作用,降低噪音敏感性,并通过自监督学习提高对复杂时间模式的解码能力。 > 1. 自适应频谱块(Adaptive Spectral Block):利用傅立叶分析增强特征表示,捕捉长期和短期交互,同时通过自适应阈值减轻噪声 > 2. 引入了交互式卷积块(Interactive Convolution Block):利用自我监督学习来完善 TSLANet 在解码复杂时间模式方面的能力,并提高其在不同数据集上的鲁棒性 综合实验表明,在分类、预测和异常检测等各种任务中,TSLANet 的表现都优于最先进的模型,展示了它在各种噪声水平和数据大小下的弹性和适应性 ## Transformer 模型的不足 1. 尽管 Transformers 在时间序列预测方面取得了初步成功,但在应用于各种时间序列任务,尤其是数据集较小的任务时,存在过拟合。(其庞大的参数规模,可能会导致过度拟合和计算效率低下的问题。) > Wen, Q., Zhou, T., Zhang, C., Chen, W., Ma, Z., Yan, J., and Sun, L. Transformers in time series: A survey. In IJCAI, pp. 6778–6786, 8 2023. 2. 其注意力机制往往难以应对时间序列数据中固有的噪声和冗余。 > Li, K., Wang, Y., Peng, G., Song, G., Liu, Y., Li, H., and Qiao, Y. Uniformer: Unified transformer for efficient spatial-temporal representation learning. In ICLR, 2022. 3. Transformers 中的自我注意本质上是包覆不变的(permutation-invariant),这影响了时间信息的保存。(在时间序列预测方面,单个线性层的表现竟然优于复杂的 Transformer 架构。不过,虽然这种线性模型可以很好地处理少量、干净的数据,但它们可能无法处理复杂、有噪声的时间序列。) > Zeng, A., Chen, M., Zhang, L., and Xu, Q. Are transformers effective for time series forecasting? AAAI, 2023. > > Li, Z., Qi, S., Li, Y., and Xu, Z. Revisiting long-term time series forecasting: An investigation on linear mapping. arXiv preprint arXiv:2305.10721, 2023.  如图 1 所示,与最先进的基于 Transformer 的架构相比,直接的 3 层 CNN 网络在分类方面(分类结果是 10 个 UEA 数据集的平均值)表现出更优越的性能。 然而,实验表明,CNN 在预测方面(预测结果是长度 {96, 192, 336, 720} 的平均 MSE 值)的功效随数据频率的变化而变化。例如,在频率为 10 分钟的短时间天气数据集上,CNN 的性能与这些基于 Transformer 的模型相比具有竞争力,但在频率为每小时的较长时间 ETTh1 数据集上,CNN 的性能却难以与之匹敌,这表明 **CNN 难以应对频率较低的时间变化**。 这种差异凸显了一个关键问题:如何才能增强 CNN,使其在更广泛的时间序列任务中发挥更强大的性能?显而易见,可以**通过学习时间序列数据中的短期和长期依赖关系来扩展 CNN 的功能**。 ## TSLANet  1. 用轻量级自适应频谱块(Adaptive Spectral Block)取代了计算成本高昂的自关注: - 自适应频谱块旨在涵盖整个频谱,从而巧妙地捕捉数据中的长期和短期相互作用。这是通过全局和局部滤波器的傅立叶乘法实现的,类似于循环卷积。 - ASB 通过自适应阈值方法选择性地衰减高频率,这一策略旨在最大限度地减少噪音,提高信号的清晰度。 2. 用交互卷积块(Interactive Convolutional Block)取代了标准的前馈网络: - 在交互卷积块中,不同内核大小的 CNN 相互控制,从而增强了模型捕捉和解释复杂时态模式的能力。 3. 采用了按数据集自我监督预训练的方法来增强模型的能力,尤其是在大型数据集上的能力。 ## TSLANet相对于传统Transformer模型有哪些优势? TSLANet相对于传统Transformer模型的优势在于: - TSLANet利用自适应谱块和交互式卷积块来增强特征表示,捕获长短期交互作用,降低噪音敏感性,并通过自监督学习提高对复杂时间模式的解码能力。 - TSLANet在各种任务中的性能优越,包括分类、预测和异常检测。 - TSLANet通过自适应阈值和傅立叶分析来应对时间序列数据中的噪音和长短期依赖关系。 ## 该研究如何证明TSLANet在各种任务中的性能优越性? 该研究通过在116个数据集上进行分类实验,包括85个单变量UCR数据集、26个多变量UEA数据集以及其他5个数据集,证明TSLANet在分类任务中表现优越。此外,研究还通过添加不同高斯噪声水平的时间序列,对比了TSLANet和Transformer模型的性能,结果显示TSLANet在高噪声环境下保持相对稳定的性能。 ## TSLANet如何通过自适应阈值和傅立叶分析来应对时间序列数据中的噪音和长短期依赖关系? TSLANet通过自适应阈值和傅立叶分析来应对时间序列数据中的噪音和长短期依赖关系。它利用自适应阈值来减少噪音的影响,并通过傅立叶分析来捕获长期和短期交互作用。这样可以降低噪音敏感性,同时保留重要的信号特征。

zhangyuheng

2024年4月17日 10:54

转发文档

收藏文档

上一篇

下一篇

手机扫码

复制链接

手机扫一扫转发分享

复制链接

Markdown文件

分享

链接

类型

密码

更新密码